新しい挑戦とささやかな体験(プログラミング独学独習者が短期間で音声AIチャットボットモデルを作れた理由)

私も昨今のAIの進化に驚いている者の一人です。

ですが、ただ驚くだけでは、そこに何らの発展性もないです。

そこでAIの学習のしくみを知ることで、それを人間の能力成長に結びつけられないかと思い、

一念発起( ※ただし、後述するようにモチベ-ションは非常に低い状態 )した格好になります。

具体的には新しい挑戦として苦手意識の強いPythonによる機械学習コ-ディングを2023年2月くらいから独学で学び始めました。

こういう取り組みが、自己改善や自己統御に貢献するか?と言うと、やや疑問です。

ですが、苦手分野の新しい取り組みは、謙虚にならざるを得ないです。

ですので心を謙虚にする意味でも、よいことだと思ったというのもあります。

それに機械学習分野は、時代の流れから、

「 ( いくら苦手意識があっても )プラスアルファで取組んで機械学習のコ-ディングスキルを身につけたほうがいいよね!」

と思ったというのもあります。

「7つの習慣」に沿って述べるならば、オレンジ枠の活動の一環として取り組んだということになります。

以下の時間管理のマトリクスで活動を整理し、緊急事項ではないが重要な事を炙り出し、淡々と実行するのは生活の質を高めるのに、平凡な手法ですが有名ですよね。

とは言え取組んだのは、< ぶっちゃけると >もう一つ別の裏の動機・理由もありました。

サイトを公開してますと、当然いろんな方がいます。(-_-;)

なかには

「 心身統一法を実践継続したり、、あるいは能力開発などに地味に取り組んで右脳開発したり速読スキル等を身につけても、

そんなのは全く役に立たない 」というネガティブな匿名メ-ルが、

レアですけど、たま---に来ることがあるわけです。

(実際のメ-ルでの文面は、こういうのではないです。

某巨大掲示板に匿名で垂れ流してるような相当に過激なメ-ルです。

オブラ-トに包んでいます。既に削除済みですけど )

もちろん、一理あるかもしれません。

速読なども、こういうスキルを使い何を何のために活かしていくのか?ということの方が、より大事です。

それより大事なのは何を学ぶか?ということの方が、もっと大事かもしれない。

今回たまたま、なりゆきで、記事に書いてるように、

人に教えられる程度には、機械学習のコーディングスキルを、たまたま身に着けましたけども

私の主観では、

機械学習のコーディングスキル < 速読スキル < 秘めた力を実際に振起させる心身統一のスキルでしょう。

どっちが幸せに直結するか考えれば当たり前ですけども。(-_-;)

取り組んでいる人に対して、こういう中傷メールは非常に失礼だと思いました。

なので、

「 割と役に立ってるよ!自覚できる顕在意識の奥の自覚できないところが消極的要素で糞詰まると心を監督できなくなってツキもなくすし意志の力が弱って心<不要残留本能や消極感情>に振り回され( 長期的に見て )碌でもないことになるよ。

よって心構えを消極にしツキを失くす奥深いところの<根深いネガティブ要素を含む心象材料>を地道に積極的な体験で上書きしていき心を扱う意志の力を渙発させると、どこがどうということもなく心身が楽になるんだ。

また心身統一法を心を取り締まって扱うスキルとして相対化して観た時に、このスキルに習熟することは不幸を避け幸せに生きることに貢献するスキルになると私は考えている。

地道に取り組むことで、価値観や優先順位、人間関係も善き方に変わる。内面の主観的な幸福感も高まる。

ただし、それらは、主観的であるため計測しにくい。

よって、以前の自分( この記事の著者 )では、到底出来そうもないと思ってたようなことも出来るようになったよ! 」というのを、客観的に示してあげたかったというのもあります。

そういう動機から、全くやったことがない、ずぶの素人の状態から独学で取り組んで、

誰の眼にも見える具体的な形で証明することで心身統一法の体系が凄いということに興味を持ってもらうのに、手っ取り早いのでは?と当時思いました。

それでキレた怒りに任せて取り組んだというのが大きいです。

( 潜在意識内の不愉快なマイナス記憶を浄化しつつ刷新することで )以前より根や克己心が出やすくなった土台の上で、怒りを闘志に変えて、

向上発展方向に振り向け、やったこともない全く新しいことに淡々と取り組んだということ。

そうして地味に取り組んで、ある程度のレベルにまで向上させることが出来たというのが、以前とは違っているかもしれません。

それ以外に他の自己啓発書の著者らが述べているのと違う、ユニークな点として実際、私は、こういうのに取り組む際に、自覚できる実在意識におけるモチベ-ションが初期状態で高かったかというと、高くありません。

そんな不退転のギリギリの決意なんてのもありません。

「 そもそもプログラミングなどは苦手意識が強いしPYTHONの機械学習コ-ディングなどの、こんな複雑で、面倒なことは、正直、やりたくはないけどな・・・ 」というとこから出発しています。

だから、一般的な成功指南書とは違うこと書いてますね。(;^_^A

成功指南書では、やる気(燃えたぎるような情熱)が大事※とか書いてますから。

私の体験では、メインコンテンツのステップ1,2,5に書いているように、

順番に段階的に取り組んで地ならしをするということ。

( 順番に取り組んで、習慣慣性の力も味方につけて、きちんと土台作りをすることが大事です )

そうして心を操作できる意志の力を渙発する。

その上で無意識(潜在意識)の機械本能的な面もある領域の改善と水路付けをする

そうすると、サイトに書いてるようなことを知らず実践してない前よりは、気が散りにくなって打ち込む力もついて加速学習しやすくなります。

ちなみに最初の2~3週間で、当時、参考にしたのは以下の書籍です。図書館なども活用し速読スキルでリラックスしつつ、淡々と大量入力しています。

機械学習について先の2冊は、入門書として学んで、その後3~4ヶ月かけて十冊近くの専門書や専門サイト(主に英語圏)の必要な箇所を拾って、情熱はなくとも学びました。

図書館で3~4冊借りて、他は数冊の英語のフリ-の機械学習のコ-ディングが書かれた割に高度なPDFで学びました。

具体的にはStanford CS229などのCSシリ-ズも活用しています。

これらの動画講義もオ-プンに公開されておりフリ-で学べる優れた教材です。

これらで基本的な機械学習の考え方を学びました。

そして、この一連のシリ-ズのコ-ディング課題ploblem setsもネットで探してスタンフォ-ドの学生が実際に期末課題で解くものを解き、ちゃんと動くコ-ドとして実装させました。

こういうのも自身の脳を宥めつつchatGpt4(3.5)に質問をしながら取り組むことで自身もレベルアップさせなかったら決して解けなかったし実装も無理だったでしょう。

尤も心身統一法をベ-スにした実践を創意工夫しながら継続し、無意識領と表面意識に積極的な水路付けをしてなかったら、恐らくは動画内容を掘り下げ知識定着させるStanford CS229のコ-ディング課題を独学でやろうという気すら起きず課題を見るなり「 無理・・ 」で終わってた可能性があります。

表面意識は、「無理じゃないか・・面倒くさい」という連想を浮かばせがちでしたが、私の無意識の、より深いところでは既に更改されており無理ではなかったのでしょう。

メインサイトに書いてるように意識水準が下がった状態で本能的な側面もある無意識領域への効果的な反復による積極暗示の水路付け、および効果的な加速学習戦略が大事な気がします。

( これが紙一重の差で効いたのではないかと自己分析しています。これらの懐柔の具体的方法はSTEP1~5で述べてますよね )

そういうのを考え合わすと、能力開発という点でも心身統一の実践体系を、実践継続していたことは、ベ-スとして素晴らしい成果をもたらしたと言わざるをえません。人それぞれとは思いますが私には,この実践哲学が合っていたのでしょう。

というのも

実際に心身統一行法を丁寧に実践していくと生活するための秘めた生存力(生命力)の振動数が高まっていくと言われています。

恬淡と楽しみながら実践していったら、どこがどうという事もなく元気になり、その派生として

体力、胆力、判断力、断行力、精神精力(克己の粘り強さ)、能力の底上げがじわじわと成されると天風哲人は述べています。

よって

6つの力の一派生の´ 能力 ´というのにフォ-カスしても、

心身統一法の実践体系を原書ベ-スで知らない方で、初期段階で同程度の知力やスキルであっても、

知って地道に実践継続しているベ-スがある方のほうが、ある意味、理不尽な力を得て

紙一重の差で自身の生命の可能性を拡げていくのではないでしょうか?

そうしたら、必然的に環境への適応力も含めて達成されやすくなるということになるのかもしれません。

あとは

継続実践以前より否定的連想も肯定的連想も超えたゾ-ン( 空 )に入りやすくなっていたことも大きかったのかもしれません。

それに加えて、自分(自我)を騙す作戦もうまくいったのかもしれません。

「 仮にも最高峰の天風哲人の心身統一法を源流、直伝の口述書経由で知って

能力開発やって教えてる人間が、この程度のことが出来ないでどうするの、、

いや世間の一般常識的に考えて出来ないと非常にまずいでしょ 」

みたいなノリでやってました。

ただし、初期状態は、先にも述べたように、自身の少しだけ自身の能力より上のことに取り組み

取り組んだこと´そのもの´を偉いことだと大きく誇張し褒め自身の脳を励まし

ある程度、出来るようになってからは

上記のようなことを言い聞かせて、なだめすかしまくって騙し騙しやってたわけです。

言葉がよくないですが、これは一種の自己洗脳です。(;^_^A

※案外、上記が自身にとって脳を騙し洗脳し潜在意識を鼓舞する暗黙のアファメ-ションになってるのかもしれないですけど、、、

別に誰に迷惑かけるわけでもなく、当の本人にとって生産性も上がり結果が付いてくる洗脳?なので、別によいのではないでしょうか?

そういう状態でして、強い目的意識などは、お世辞にもありません。

(あったほうが良いのは当然ですけど)

こういう不愉快なことを、少しでも愉快に出来るよう意志の力で方向付けしました。

そうして、ぐらっときたら、普段やってる「 信念強い 」を機に応じて言い聞かせて、

やり切り、やり抜いていることをベ-スにし、すっと立て直し、プログラミング学習を淡々とやっていったら

ある心理的一点を突破したら、学ぶのが少しずつ楽しくなって情熱も出てきました。

プログラミングを含めた機械学習のスキル習得がぐんぐん加速して学ぶのも楽しくなっていったという体験があります。

具体的には、先の写真の入門編の黄色の本や右のデ-タサイエンティスト育成講座の本を、パラパラめくって、ざっと読んで、

Hello!Worldをprint表示できることに、すごい!と感動したあとは

黄色の入門編は、性懲りもなく一番最終の章から、右の本も、ほんと、とても面倒くさそうな中で

自身にとって、ややこしそうだが、少しは興味を感じて面白そうだと思った後半も後半の章の決定木やランダムフォレスト、

勾配ブースティング等の章から、途中をすっ飛ばして、小さく始めたということ。

そうして、モチベ-ションも相当に低い中で、

私のお道具の脳が、今まで全くやったこともない新しいことに取り組んでるもんだから、

危険信号出して、アレルギ-反応をバリバリ出して嫌がるのを

フ-ンと等閑視しながら、最小構成で動かせるものを作って、ちょっとでも出来たらお道具の脳を励まし勇気づける。

理論はわからずとも動けば正義で、(最小構成で)実装出来てから各コードの動きを逆算で確かめる。

その際に、手を動かし取組んでいること自体を楽しむように仕向けて続けていくと、、

何となくコ-ドの全体構造や流れを大きく理解できるようになりました。

そうして少し理解出来たら、

思いっきり、すっ飛ばした基礎を、後で繋げる。

基礎のコ-ドや技術が、どういうふうに後半の機械学習の、より実践に近い応用的な章に繋がっているか、

それを俯瞰しながら埋めていく、、、というようなやり方です。

尤も、こんな非常識な学習法をやってたら高校時代とかだったら

先生に怒られてるでしょうが、

縛られる必要もない。社会人なのだから、別にどんな学習法を採用したっていいでしょう。

ただし、心身統一法の地道な実践や柔軟な学習法だけで、スキル獲得の加速が出来たのではないでしょう。

とりわけ独学での機械学習(およびプログラミング)の学習速度を十倍以上に加速させたのは、、、、、

冷静に考えて、(心身統一法をベ-スにした自己訓練以外では)どう考えても

以下のchat GPTの力が大きいと自己分析しています。

機械学習のプログラミングスキルの習得に取組み始めて、悪戦苦闘していた1カ月過ぎた頃に、chatGPTの存在を知ったのですが

そのデバッグに大いに助けられ、先のテキストの章末の練習問題や総合課題では、物足りなく感じるようになりました。( これはGPT4の御蔭でしょう )

それで、更なるスキル向上のためにと参加したタイタニックの生存予測モデルの精度を競うkaggleのコンペにも挑戦しようと思い

煩雑な前処理の見直しやチューニング設定の見直しもGPTとの協業で行うことで、割に容易にできるようになりました。

ChatGPTの力を借りて手を動かしながら楽しく学んでいけばノンプログラマ-でpyhon入門者レベルでも、相当に機械学習のコ-ディングなどの実践的な学習が進み自身もレベルアップしていきます。

私は、これまでの人生で一度もプログラミングなど学んだことも触れたこともなく、そういうのとは無縁だった人間です。

その際にChatGPTを知らないで取り組んでいた時期も1か月位あります。

その時の学習の理解度やスキルの向上とGPTを知って活用して以降では機械学習の知識やコ-ディングのスキル習得が加速しましたから。

おおらかに、必要な箇所だけ学び終えた後に物足りないのでkaggleのコンペに挑戦しようと決めて同じやり方で取り組んだところ

タイタニックの生存者予測精度を競うスコアがどんどん向上していきました。

ChatGPTに質問を繰り返し乍ら取り組んでいったのですが

気が付いた時にはスコア・ランクが急激に上がりkaggleコンペで上位5%に入ることができていました。

精度向上をするためのデ-タの前処理や他のモデルとのアンサンブル学習などに取り組み始めて1週間かかっていなかったと思います。

これが出来たのは、心を方向付けし粘り強く為す実力とも言うべき意志力や信念が渙発され根も培われて、

ごちゃごちゃとした雑念に振り回されなくなって学習が加速できたのと

打ち込む力が付いたこと。

さらにはChatGPTのコ-ド提案力とデバッグ力があったからです。

とりわけChatGPTの貢献というのが大きいでしょう。

この記事に書いているレベルなら、何とかなってしまうというのがchatGPTの凄みではないかと思います。

一例を挙げるなら「タイタニックの生存予測のKAGGLEコンペ」

これに出した際の試行錯誤のコードが、例えば以下のようなものです。

これもChatGPTの提案をこちらで組み替えたりデバッグを繰り返して構築したものです。

(GPT3.5や有料のGPT4とchatを重ね質問を繰り返すうちに自然にpythonのコ-ディングや機械学習の専門用語に慣れていき難しいコ-ドを理解し読めるようになっていきました。

尤も、、、高精度の予測モデルを作るには、いろんなモデルの試行錯誤とデータの前処理が必要で、これが案外煩雑なのは違いありませんけど)

モチベ-ションは、相当に低かったにもかかわらず、、例えば以下のようなコ-ディングが(気が付いたら)可能になっていました。

なお、これだってGPTが提案し生成したコ-ドを、目的意識を明確にし、

こちらで調整しデバッグを繰り返して組み替えたりしただけですから、

これが私だけのコ-ディングの力かというと、決して、そうではないと断言できます。

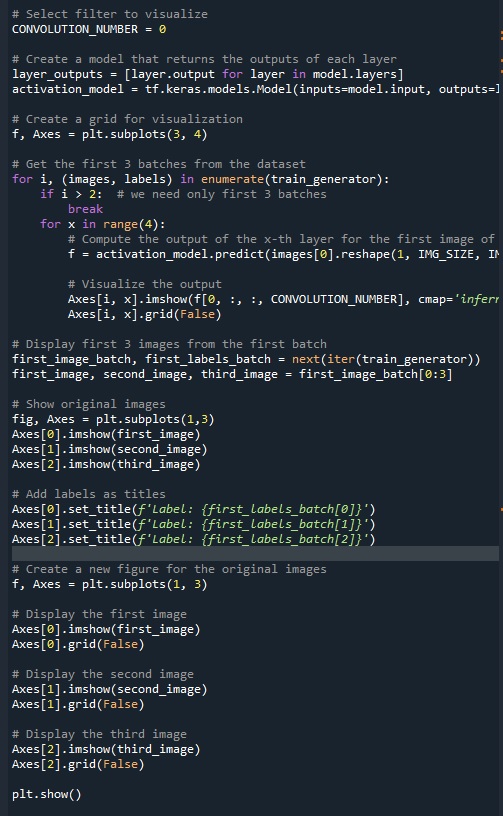

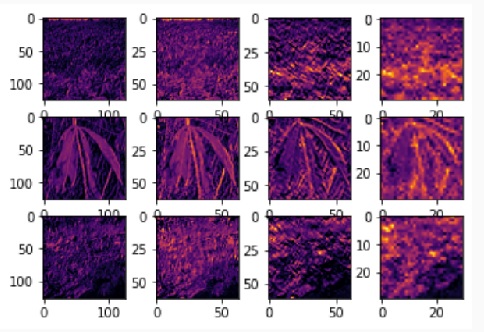

上記のコードを、簡単に解説すると、これは病気のcassavaの葉の画像分類(kaggleのコンペで出されたもの)を行う際に深層学習モデルを構築した時のものでcolabの畳み込みとプールの可視化のペ-ジを参考にしています。

cassavaの葉の画像分類のKaggleのコンペは、すでに2年前に終了しているようですが、

機械学習分野のコンピュータビジョン関連について、基本のスキルを高める為に取り組んだ時のものです。

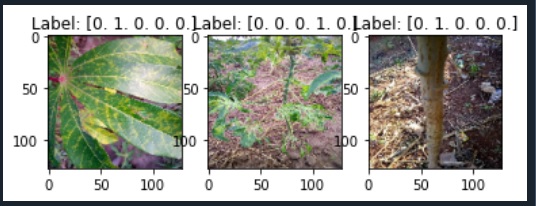

以下は、cassavaの葉(や茎)の画像です。こういうのが21367枚あります。農家の方らのクラウドソ-シングによる調査で集められたもので

ラベル付き画像データになります。

コンペの課題は、キャッサバ(cassava)の葉や茎の画像を4つの病気のカテゴリおよび健康な葉を加えた合計5つのカテゴリに、出来るだけ高精度に分類することです。キャッサバはアフリカの主要な炭水化物源で、厳しい環境でも育つことができます。そのため、食糧問題の解決の糸口になる重要な作物です。

この作物は食べ物としてだけでなく、エネルギー資源としても使われ、タピオカやキャッサバ粉に加工したり、エタノールやバイオディーゼルといった燃料を作ることも可能です。多くのアフリカ人の主食であり、その経済にも大きな影響を与えています。

この作物の分類の精度が上がれば農家の方はウィルスなどの病気にかかったcassavaの植物を迅速に特定し早く処置することで大幅な減収、減益などのダメージを受ける前に作物を救うことができるので、縁の下の<陰ながらの>地域貢献にもなると言われています。

この画像分類は、先に挙げたKAGGLEコンペのTitanicの生存予測モデルを構築するより、難易度が高かったですが

精度向上のために様々な前処理やモデルの模索、構築をしていく際にニュ-ラルネットワ-クモデル(CNN)の各層における処理も精度向上の模索の一環で確認しました。

その際に、この目的を達成するコ-ディングについてこのペ-ジを参考にしたのは勿論ですけど

試行錯誤の実験をするためにGPT4(3.5)のデバッグ能力の力を大いに借りて作りました。

(と言いますか、GPT4(3.5)のデバッグ能力がなければ私には到底できなかったでしょう)

例えば以下の画像は、cassavaの葉の疫学分類を機械学習モデルが、処理していく際に、その中間層である畳み込み層などの出力を視覚化したもので、出力結果の一部です。

先のコ-ドは、訓練用のデータセットから取得した最初の3つの画像を表示するコ-ドが含まれており、それぞれのフィルタが捉えた特徴(エッジ検出)や色の勾配などの機械モデルが特長検出で捉えた学習過程を視覚化することができます。

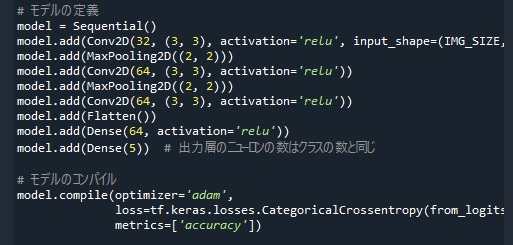

これは、例えば以下のように設定したCNNモデルが各層で学習している特徴を私たちが理解するために行うもので機械モデルを改善していくときの有力な手がかりになります。

各層が画像のどの部分に焦点を当て、それぞれのフィルタが、どのような特徴を捉えているのか知ることが出来ます。

どんどん抽象化されているのが、上記のカラ-マップを見ることで読者にも、わかっていただけると思います。

ただし、これだって、Lab4-Using-Convolutions.ipynbのペ-ジなどをご存じの方は、当たり前の基本的な事をやっているに過ぎないと思う方もいるかもしれません。

機械学習に詳しい方にとっては、これは基本中の基本でしょう。

そのとおり、ど正論だと思います。

とは言えCNNモデルに応用し、python2~3か月学んだ程度で実装するのはChatGPTのデバッグの力や提案があって、自身も少しずつレベルアップしていかなければ到底無理だったでしょう。

なおcassavaの葉の画像分類については、精度向上に向けてchatGPTの力を借りて私もいろいろ試行錯誤しましたが、結局のところ上記のCNNモデルでは、accuracyは、向上しても肝心なVal_accuracyが向上しませんでした。

画像を前処理するためにPyTorchのTransformsライブラリを利用し、画像のリサイズや色調の調整、正規化などを行って

Vision Transformer (ViT)の使用および交差検証(K-Fold)を使用したモデル。

これが今回取組んだ中では汎用性の指標であるVal_accuracy(検証精度)が高かったです。

val_accuracy82%くらいでした。

で、結局この精度まで向上できたのもChatGPTのデバッグの力が背後にあるというオチが付きます。

上記以外にも例えば、機械学習、とりわけLLMなどのファインチュ-ニングの分野は、

今後、さらに重要な分野になると思いましたので、

急遽、私的取り組みで音声応答チャットボッドを作製してみました。

で、これも結局、タスク分解し細分化し、段階的に取り組んだのとGPT3.5(4)に質問しまくって私自身も理解が進みレベルアップできたことで作ることができたというオチが付きます。

その経緯を含めて、なぜノンプログラマ-で独学独習でも自身のレベルが徐々に上がっていき出来てしまうのか?という理由など

ゆっくり動画というのを初めて作ってアップしました。

初めてアップしたのが、まさかの、ずんだもんということになってしまいました。

こういうのでインスパイアされる人が少しでもいて、pythonなどのプログラミングや

機械学習の敷居が下がっていることを知ってもらえるなら作った甲斐はあるというものです。

上記動画を見れば、GPT3.5やGPT-4を取り入れたらプログラミングなどのスキル獲得や機械学習を学ぶのに、十倍以上の時短にもなるというのが肌感覚で確認できると思います。

特に、動画後半の、なぜ非プログラマ-でもレベルが上がっていき出来てしまうのか?というのは、

Pythonなどのプログラミングを学習する際も知らないで取り組むのと

知って系統的かつ実践的な学習をするのでは学習効率および自身のレべルアップの速度が

天地雲泥になるのではないかと。

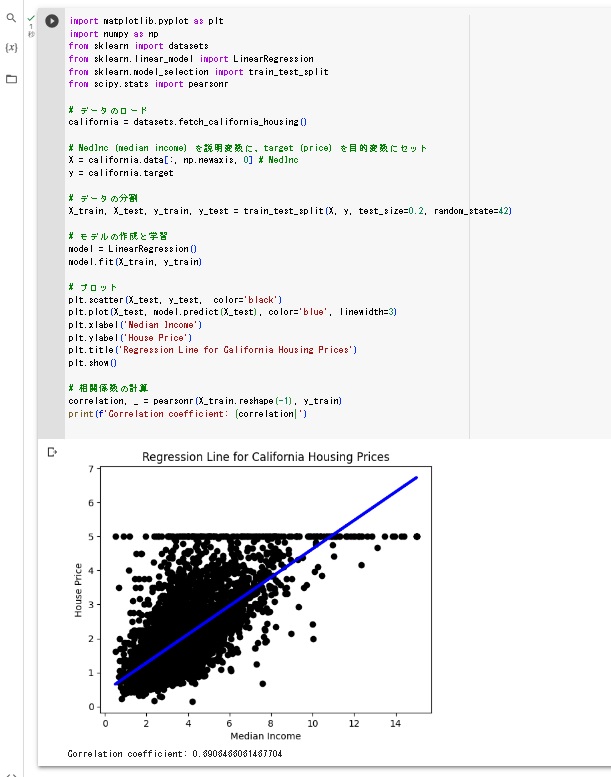

例えば、動画内で紹介した単回帰のコ-ド依頼と質問に対して生成したコ-ドは以下の私的なリンクをPDF化し公開しておきましたので閲覧も出来ます。

Calif. Housing Price Regression

これをcolabなどに貼り付け実行すると以下のように描画されて結果が出てしまうんです。

(尤も、ある程度機械学習に詳しくなっていなければ、このプロンプト自体が作れませんけど、やってるうちにコ-ドが読めるようになり作って修正するのにも慣れていきます)

意味が分からなければ、コ-ドの意味や働きを質問したら、懇切丁寧に解説もしてくれます。

この一事だけでGPT4(または3.5)のコ-ド提案力と生成力の能力の凄さや

学習を加速させることを知らせるのに十分でしょう。

またGPTとチャットを重ねて学んで自身もレベルアップさせれば、

動画にあるように

カスタマイズされた音声チャットボットなどの機械学習分野のコ-ディングの知識やスキルも

GPTとの協業で短期間で修得出来る可能性があるよ!という私の主張も嘘ではないというのがわかるはず。

きっかけ(積極的な刺激)になれば、それだけでも作った甲斐はあると思うし

積極的刺激になればよいので、コ-ドの説明は不要でしょう。

ビジネスに貢献するためのAIをどうやって作るのか?言い換えれば人とAIの共創という限定された視点で観ても

単純に機械学習やコ-ディングについてGPT3.5などを介して学ぶ方法を早くから知って

プラスアルファで目的をもって決めて取り組むか、

それとも知らないで、難しいと思い込んでいるかで、その後の自身のレベルアップや成果(その後の展開)に大きな格差を生んでしまうのではないでしょうか?

尤も、アップした動画は、「 しょせん個人の趣味の域を出ないもの 」と考える方もいらっしゃるかもしれません。

確かにそのとおりです。

ですが、機械学習のスキルや知識をバックにし音声チャットボットを作製するという、

この小さなプロジェクトを達成するのですら様々な機械学習の背景知識やPCスキルの組み合わせが必要です。

私が初っ端で学んだ市販のテキストは簡単な解説や模範のコ-ドがあるからともかく、、

タイタニックの生存予測モデルで上位に入るための高精度化やcassavaの葉の疫学分類の判別率の高精度化は、

先の市販のテキストの総合問題などを解くよりかは、発想力や創意工夫が必要です。

特定のキャラの音声チャットモデルを訓練し、相応のものを作るのは、

それらより、難易度が高く、いろんなPCスキルと組合わせる実務的な応用力が必要です。

よって、これらのモデルを作製出来る背景知識やスキルがあれば

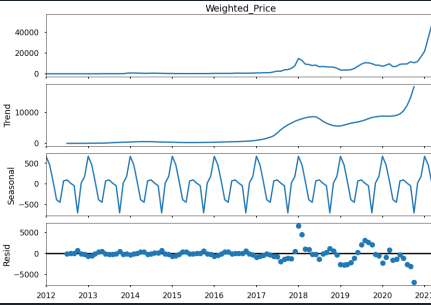

このスキルや背景知識を少し応用すればLSTMやARIMAなどのモデルを用いて金融工学に適用できます。

例えば、簡単なモデル構築の例では、以下のような季節変動を考慮したビットコインの価格予測モデルの構築、検証などです。

あるいは化学工学などの分野ではRandom Forest等のモデルで化合物スクリーニング等への応用にも可能性があることを意味します。

なかでもファインチュ-ニングや転移学習のスキルは、今後非常に価値が出てくると私は考えています。

ということで、いろんな意味で、とりわけ機械学習分野のスキルを磨くのに本当に、お薦めです。

↓ ↓

OPEN AI

GPTの出現が、あまりに革命的で機械学習のスキル習得の敷居が下がったと思いますから

本当に、こういったスキルの習得が、ちょっとは難しいのか判断は難しい。

こういう記事も数カ月で陳腐化するかもしれないですけど。

chatGPTなどの生成系AIの出現でコ-ディングの技術スキルより

発想力や柔軟性、俯瞰力や統合力のほうが重要度が増したのかもしれません。

となると、なおさら心身統一法の出番ということになりますね。

効率的に加速学習が可能になったのはchatGPTへの質問のし方も関係するかもしれません。

pythonのプログラミングや機械学習を学ぶ過程で、GPT3.5(4)への質問のし方もレベルアップしたように思います。

今回、記事に書いたようにモチベ-ションが低い中で短期間で加速学習できたのは

chatGPTに求める結果を明確に示して段階的かつ具体的に質問をし、

自身もレベルアップすることで質問自体をレベルアップできたというのも、よかったのかもしれません。

機械学習のコ-ディングスキルを悪戦苦闘しながら身に着けるプロセスで、

どういう質問がAIにとって答えやすいか?そういうのも、なんとなく自然に身についた気がします。

機械学習分野については今後も心身統一法の実践研究と同様に様々なジャンルについて

これからも少しずつスキルを磨くつもりではいます。

こういう分野に取り組む以前の自分が、できないかもと思っていたことが、( 出来ない中で )出来ることを押し広げることで、

( やっていくうちに )

気が付いたら出来ていたという体験というのは、結構嬉しいことでした。

Pythonプログラミングで機械学習を学ぶのに、ベ-シックの言語が英語なので

強制的に英語学習にもなり一石二鳥どころか三鳥、四鳥になった気がします。

大きな自信(励み)になりましたし、とても愉快な体験になりました。

それに、ちょっと背伸びをするくらいの心の負荷になるような新しいことに挑戦し

心が働く基盤である脳神経系基盤も肉体を扱うように適切に鍛えて使ってあげることで、

脳基盤も今まで使ってない領域が使われ脳に繋がった心を進化させることが出来るのではないでしょうか?

サイトや講座などの実践を通じて、読者の方々が、自己統御の力を高めて、様々なスキルを獲得し、それぞれの自己実現を目指し豊かにするための前向きなヒントを見つけていただければ幸いです。

PS

chatGptがpythonのプログラミング学習や機械学習を加速させたのは間違いないでしょう。

その性能も、当時より爆発的に進化しています。

よって2023年初頭の2月くらいからプラスアルファで取組んで独学で短期間にスキルの習得が出来たからとは言え、

これは、本当に、ほんのちょびっとは難しい事なのか?

心身統一法は、能力開発というのでも凄いよ!!の証明に信憑性が薄れるのが、残念ですけど、

少なくとも心身統一法の実践継続で向上を促す高次の意志力渙発や信念強化および潜在意識を積極化し

前向きにし向上を促す何らかの流れみたいなものの支援を受けていない、当時だったら、

いくら実在意識でモチベ-ションを高めてやろうとしても

挑戦すらしてなかったか、挑戦しても、すぐに諦めて投げ出していたかもしれません。

今回の事例でも詳細を述べたように

モチベ-ション低く、「こんなことしてどうする」。「できれば、やりたくない」。

みたいな弱い気持ちと、ひねくれた思いが実際湧いても

いつしか雑念が消え、紙一重の、あと一歩の粘りも発揮され

面白くなっていき気が付いたら、スキルを身に着けていたという塩梅でした。

口述書の心身統一法で潜在意識を薫習する以前と以後を比べたら、以下のようになるでしょう。

これは、サイトでも書いてますけど。こういう簡潔なもので、比較的に表すことも出来ます。

ささやかな体験ですが、こういう小さいプロジェクトだって以前だったら、このような記事にも出来てなかったかもしれませんから。

※このあたりの詳しい説明については、心の積極性についての素朴な問い(潜在意識の秘密)に詳述しています。

こういうアプロ-チは唯物論的な考えに染まって偏るのでなく、かといって唯心論的なスピリチュアル一辺倒に偏重するのでもないバランスの取れた優れた方法だと思っています。